在数据中心及

AI

人工智能领域,NVIDIA

的GPU

优势明显,AMD

现在也在一步步追赶,日前微软宣布首家采购AMD

的MI200

系列加速显卡,用于云端大规模AI

训练。在日前的

Build 2022

大会上,微软首席技术官

Kevin Scott

宣布Azeure

将成为首个部署AMD

旗舰级MI200

系列GPU

进行大规模AI

加速的公共云服务。MI200

系列加速卡去年11

月份发布,AMD

当时称其性能比NVIDIA

的A100

加速卡快5

倍,特别是在FP64

计算中。

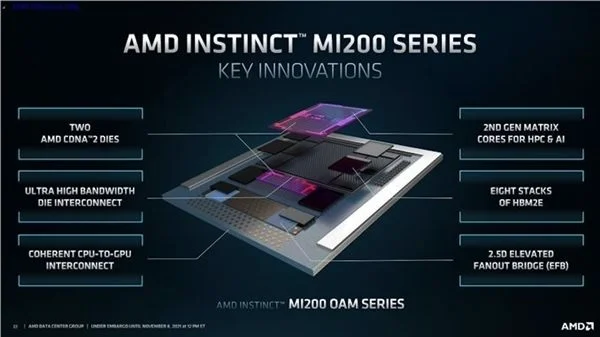

MI200

系列升级为新的CDNA2

计算架构,搭配升级的6nm FinFET

工艺,580

亿个晶体管,并使用2.5D EFB

桥接技术,业内首创多Die

整合封装(MCM)

,内部集成了两颗核心。新系列分为两款型号,

Instinct MI250X

集成了220

个计算单元、14080

个流处理器核心,最高频率1.7GHz

,并有880

个第二代矩阵核心,峰值性能为:FP16

半精度383TFlops

、FP32

单精度/FP64

单精度47.9TFlops

、FP32

单精度/FP64

双精度矩阵95.7TFlops

、INT4/INT8/BF16 383TFlops

。内存

/

显存搭配8192-bit

位宽的128GB HBM2e

,频率1.6GHz

,峰值带宽3276.8GB/s

,并支持全芯片ECC

。整卡采用

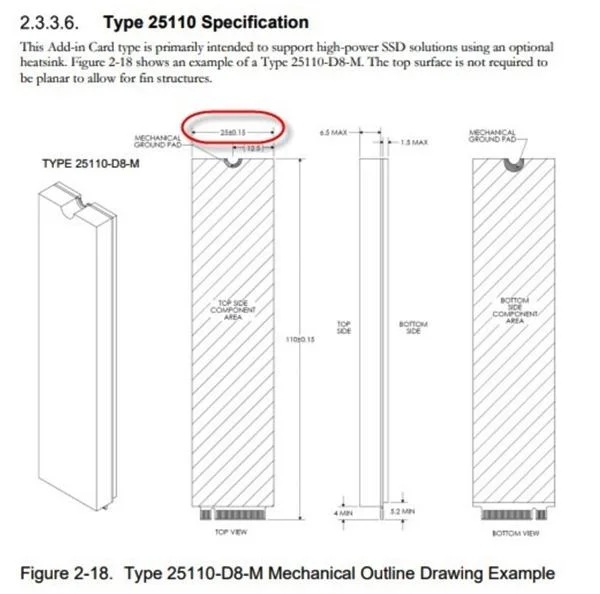

OAM

模块形态(

未来也会推出PCIe

扩展卡形态)

,支持PCIe 4.0 x16

, 被动散热(

系统散热)

,典型功耗500W

,峰值功耗560W

。Instinct MI250

精简为208

计算单元、13312

流处理器核心,各项性能指标也顺应下降约5.5

%,其他规格完全不变。

话题标签: AMD 微软 显卡

【来源:快科技】【作者:宪瑞】